资源

翻译自 Huggingface Blog

在线工具

GitHub

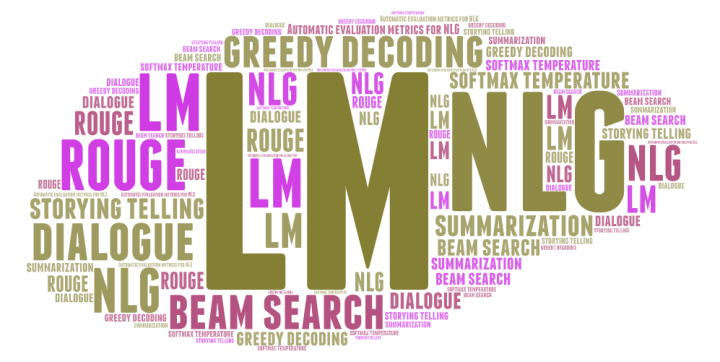

引子随着机器学习数据集统一平台的快速发展(Lhoest et al. 2021),HuggingFace团队开始探索如何管理数据集文档(McMillan-Major

2022-02-05